Bukan fiksi ilmiah: pria lumpuh mengendalikan lengan robot hanya menggunakan pikirannya

yang baru dikembangkan[{” attribute=”” tabindex=”0″ role=”link”>artificial intelligence can adapt to brain changes during learning, allowing individuals with paralysis to control and move objects.

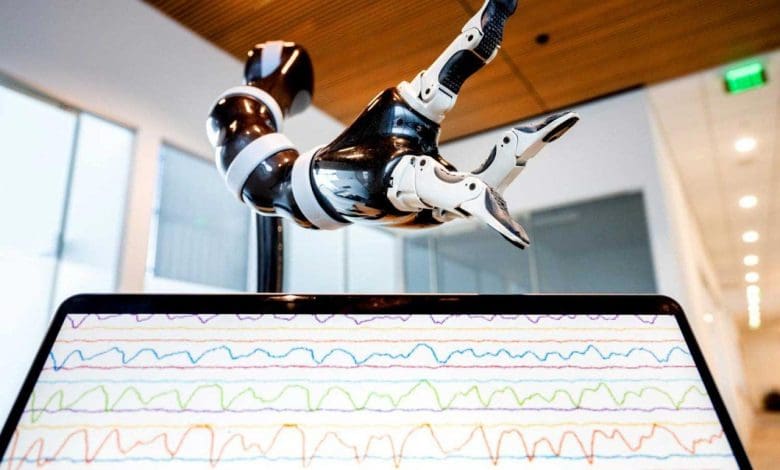

Researchers at UC San Francisco have enabled a paralyzed man to control a robotic arm using a device that transmits signals from his brain to a computer.

By simply imagining himself performing the actions, he was able to grasp, move, and drop objects.

The device, known as a brain-computer interface (BCI), functioned for a record seven months without requiring adjustments. Until now, such devices had only worked for a day or two.

The BCI relies on an AI model that adapts to subtle changes in the brain as a person repeats a movement—or, in this case, an imagined movement—gradually refining their ability to perform it.

“This blending of learning between humans and AI is the next phase for these brain-computer interfaces,” said neurologist, Karunesh Ganguly, MD, PhD, a professor of neurology and a member of the UCSF Weill Institute for Neurosciences. “It’s what we need to achieve sophisticated, lifelike function.”

The study, which was funded by the National Institutes of Health, appears March 6 in Cell.

The key was the discovery of how activity shifts in the brain day to day as a study participant repeatedly imagined making specific movements. Once the AI was programmed to account for those shifts, it worked for months at a time.

Location, location, location

Ganguly studied how patterns of brain activity in animals represent specific movements and saw that these representations changed day-to-day as the animal learned. He suspected the same thing was happening in humans, and that was why their BCIs so quickly lost the ability to recognize these patterns.

Ganguly and neurology researcher Nikhilesh Natraj, PhD, worked with a study participant who had been paralyzed by a stroke years earlier. He could not speak or move.

He had tiny sensors implanted on the surface of his brain that could pick up brain activity when he imagined moving.

https://www.youtube.com/watch?v=5xivizsi44g

Salah satu peserta penelitian, yang kehilangan kemampuannya untuk bergerak dan berbicara bertahun -tahun yang lalu dengan stroke, menggerakkan lengan robot hanya dengan membayangkan gerakan di kepalanya. Kredit: UCSF

Untuk melihat apakah pola otaknya berubah dari waktu ke waktu, Ganguly meminta peserta untuk membayangkan menggerakkan berbagai bagian tubuhnya, seperti tangan, kaki, atau kepalanya.

Meskipun dia tidak bisa benar -benar bergerak, otak peserta masih bisa menghasilkan sinyal untuk gerakan ketika dia membayangkan dirinya melakukannya. BCI merekam representasi otak dari gerakan -gerakan ini melalui sensor di otaknya.

Tim Ganguly menemukan bahwa bentuk representasi di otak tetap sama, tetapi lokasi mereka sedikit bergeser dari hari ke hari.

Dari virtual ke kenyataan

Ganguly kemudian meminta peserta untuk membayangkan dirinya membuat gerakan sederhana dengan jari, tangan, atau ibu jari selama dua minggu, sementara sensor merekam aktivitas otaknya untuk melatih AI.

Kemudian, peserta mencoba mengendalikan lengan dan tangan robot. Tapi gerakannya masih belum terlalu tepat.

Jadi, Ganguly memiliki latihan peserta di lengan robot virtual yang memberinya umpan balik tentang ketepatan dari visualisasinya. Akhirnya, dia mendapat lengan virtual untuk melakukan apa yang dia inginkan.

Begitu peserta mulai berlatih dengan lengan robot yang sebenarnya, hanya perlu beberapa sesi latihan baginya untuk mentransfer keterampilannya ke dunia nyata.

Dia bisa membuat lengan robot mengambil balok, mengubahnya, dan memindahkannya ke lokasi baru. Dia bahkan bisa membuka kabinet, mengeluarkan Cu, P dan menahannya ke dispenser air.

Beberapa bulan kemudian, peserta masih dapat mengendalikan lengan robot setelah “tune-up” 15 menit untuk menyesuaikan bagaimana representasi gerakannya melayang sejak ia mulai menggunakan perangkat.

Ganguly sekarang menyempurnakan model AI untuk membuat lengan robot bergerak lebih cepat dan lebih lancar, dan berencana untuk menguji BCI di lingkungan rumah.

Bagi orang dengan kelumpuhan, kemampuan untuk memberi makan diri mereka sendiri atau minum air akan mengubah hidup.

Ganguly berpikir ini dalam jangkauan.

“Saya sangat yakin bahwa kami telah belajar cara membangun sistem sekarang, dan bahwa kami dapat membuat ini berhasil,” katanya.

Referensi: “Sampling Plastisitas Representasional dari gerakan imajiner sederhana sepanjang hari memungkinkan kontrol neuroprostetik jangka panjang” oleh Nikhilesh Natraj, Sarah Seko, Reza Abiri, Runfeng Miao, Hongyi Yan, Yasmin Graham, Adelyn Tu-Chan, Edward F. Chang dan Karun Gangul, 6 March, Adelyn Tu-Chan, Edward F. Chang, dan Karun Ganguul, Ganguul, 6 March, Adelyn Tu-Chan, Edward F. Chang, Sel.

Doi: 10.1016/j.cell.2025.02.001

Studi ini didanai oleh National Institutes of Health dan UCSF Weill Institute for Neurosciences.